作者 | ZeR0,编纂 | 漠影

Blackwell架构大揭秘!对话英伟达手艺高管+22页手艺呈报解读。

芯货色3月24日报导,现今全球身价最高的两位华人,一名卖铲,一名卖水。第一名是英伟达创始人兼CEO黄仁勋,靠给淘金者们卖GPU,把英伟达推上环球市值第三的宝座;另一位是农民山泉创始人、董事长兼总经理钟睒睒,凭“大自然的搬运工”笑傲饮用水江湖。

以后,英伟达市值曾经稳坐2万亿美圆大关,与苹果的市值差距缩小到0.3万亿美圆。

在本周英伟达GTC大会上,黄仁勋一本端庄地说:“咱们能够附带着卖热水。”这可不是句玩笑话,黄仁勋是有数据根据的:英伟达DGX新机的散热,液体进口温度是25℃,靠近室温;进口温度降低到45℃,靠近推拿浴缸的水温,流速是2L/s。当然了,比起卖水,GPU才是英伟达手里的印钞机。

人称“皮衣刀客”的黄仁勋,一贯拥有极强的危机感和危险认识,永远在提前为将来铺路。再加上行业是一个高风险高成本低容错的行业,一步走错,大概就会跌落神坛,满盘皆输。所以在需要绝后迸发、一众劲敌虎视眈眈的关头时辰,英伟达不敢在新品上有涓滴懒惰,幸免会在短期内打出最大迸发,让敌手们望尘莫及。当合作敌手们还在以追逐英伟达旗舰GPU为目的时,黄仁勋曾经站在next Level,捕捉到客户需要的痛点——单芯不顶事,真正顶事的是解决体系级功能和能效晋升的挑衅。

拿单个旗舰GPU比,英伟达的芯片确凿配得上“核弹”称呼,功能猛,功耗也高。但黄仁勋锋利在早就跳出芯片自身,不息向数据中央客户贯注“买得越多 免得越多”的理念,简而言之买英伟达的AI体系计划比其余计划更快更省钱。从Blackwell架构设想到AI根底办法的手艺结构,都能反应黄仁勋对将来市场需乞降行业趋向的前瞻性判别:

1、动员功能晋升愈来愈捉襟见肘,单die面积和快到极限,后续芯片迭代必需包孕高带宽内存、Chiplet、片内互联等手艺的立异组合。再加上片外互连等高功能的优化,配合构成为了英伟达打造出专为万亿参数级天生式AI设想的体系的根底。

2、将来,数据中央将被视为AI工场,在全部性命周期里,AI工场的目的是发生收益。不同于花费级市场单卖显卡,数据中央市场是个体系级买卖,单芯片峰值功能参考代价不大,把不少GPU组合成一个“巨型GPU”,使其在实现一致计较使命时花费更少的卡、时候和电力,对客户能力带来更大的吸引力。

3、AI模子的范围和数据量将继续增进:将来会用多模态数据来锻炼更大的模子;天下模子将大行其道,进修控制理想天下的物理纪律和知识;借助合成数据天生手艺,AI甚至能仿照人类的进修体式格局,遐想、思索、相互互相锻炼。英伟达的目的是不息下降与计较相干的本钱和能耗。

4、高性能推理或天生将相当首要。云端运转的英伟达GPU可能有一半时候都被用于token天生,运转少量的天生式AI使命。这既需求进步吞吐量,以下降办事本钱,又要进步交互速率以进步用户体验,一个GPU难以胜任,是以必需找到一种能在许多GPU上模子事情的要领。

01.最强AI芯片规格详解:最大功耗2700W,CUDA设置成谜

本周二,英伟达宣布新一代Blackwell GPU架构,不但决心弱化了单芯片的存在感,并且没有明确GPU的代号,而是费解地称作“Blackwell GPU”。这使得被公认遥遥当先的Blackwell架构几何笼上了一抹奥秘颜色。在GTC大会现场,英伟达副总裁Ian Buck和高等副总裁Jonah Alben向智货色&芯货色等环球媒体进一步分享了对于Blackwell架构设想的暗地里思索。

连系22页英伟达Blackwell架构手艺简报,对于GB200超等芯片、HGX B200/B100、DGX等的设置细节被进一步表露。依据现有信息,全新Blackwell GPU没有接纳最进步前辈的3nm制程工艺,而是连续相沿4nm的定制增强版工艺4NP,已知的芯片式子有3类——B100、B200、GB200超等芯片。

B100不是新宣布的配角,仅在HGX B100板卡中被说起。B200是重头戏,GB200又进一步把B200和1颗72核Grace 拼在一路。B200有2080亿颗晶体管,跨越H100(800亿颗晶体管)数目的两倍。英伟达没吐露单个Blackwell GPU die的详细巨细,只说是在reticle巨细尺寸限定内。上一代单die面积为814mm²。因为不知道详细数字,欠好计较B200在单元面积性能上的改良幅度。

英伟达经由过程NV-HBI高带宽接口,以10TB/s双向带宽将两个GPU die互联封装,让B200能像单芯片同样运转,不会由于通讯消耗而丧失功能,没有内存部分性问题,也没有缓存题目,能支撑更高的L2缓存带宽。但英伟达并无吐露它详细采用了怎么样的计谋。前代GH200超等芯片是把1个H100和1个Grace CPU组合。而GB200超等芯片将2个Blackwell GPU和CPU组合,每一个GPU的满配TDP达到1200W,使得全部超等芯片的TDP达到2700W(1200W x 2+300W)。

▲Blackwell GB200规格(图源:芯货色依据手艺简报表格译成中文)

值得存眷的是,Blackwell架构手艺简报仅披露了Tensor焦点数据,对CUDA核心数、Tensor核心数、向量算力等信息只字未提。除了FP64是浓密,其余数据花样都表现了稠密算力。

相比之下,规范FP64 Tensor焦点计较功能晋升幅度不大,H100和H200是67TFLOPS,GB200超等芯片是90TFLOPS,比上一代进步34%。一种大概的推想是Blackwell架构的设想周全倾向AI计较,对高性能计较的晋升不明显。假如晶体管都用于堆Tensor焦点,它的通用才能会变弱,更像个偏科的AI NPU。因为接纳沟通的根底办法设想,从Hopper换用Blackwell主板就像推拉抽屉同样便利。手艺简报披露了Blackwell x86平台HGX B100、HGX B200的体系设置。HGX B200搭载8个B200,每一个GPU的TDP为1000W;HGX B100搭载8个B100,每一个GPU的TDP为700W。

在数据中央Blackwell GPU宣布后,业界存眷核心移向异样基于Blackwell架构的游戏显卡RTX 50系列。今朝间隔RTX 50系列GPU的宣布日期还很悠远,最快也失掉往年年末,慢点大概要到来岁以至是后年。无非当初已经有不少对于设置的传言,比方接纳台积电3nm和28Gbps G 7显存、最大宽度有384bit和512bit两种说法,芯片包孕从入门级GB207到高端级GB202,会连续优化门路追踪、光芒追踪。

02.8年AI锻炼算力晋升1000倍,英伟达是怎样做到的?

从2016年Pascal GPU的19TFLOPS,到往年Blackwell GPU的20PFLOPS,黄仁勋发布英伟达用8年将单卡AI锻炼功能提升了1000倍。

这个听起来使人心潮磅礴的倍数,除了得益于制程工艺迭代、更大的HBM容量和带宽、双die设想外,数据精度的下降起到关头感化。

多半锻炼是在FP16精度下举行,但实际上不需要用这么高的精度去处置所有参数。英伟达一直在索求怎样经由过程混杂精度操纵来在下降内存占用的同时确保吞吐量不受影响。Blackwell GPU内置的第二代Transformer引擎应用进步前辈静态局限治理算法和细粒度缩放手艺(微型tensor缩放)来优化功能和精度,并首度支撑FP4花样,使得FP4 Tensor功能、HBM模子范围和带宽完成翻倍。

同时TensorRT-LLM立异包孕量化到4bit精度拥有专家并行映照的定制化内核,能让MoE模子及时推理应用花费、能量本钱。NeMo框架、Megatron-Core新型专家并行手艺模子锻炼功能晋升供应支撑。降精度的难点统筹用户对准确率需要。FP4并不在甚么时间无效,英伟特地夸大混杂专家模子言语模子带来优点。把精度降到FP4大概会有疑惑增添题目,英伟心肠加了个过渡的FP6,这个花样尽管没什么功能上风处置数据量比FP8缩小25减缓内存压力。

03.90天2000块GPU锻炼1.8万亿参数模子,8000个GPU、90天锻炼,耗电15MW;而用Blackwell异样花90天只要2000个GPU,耗电仅4MW。省钱与省电成正比,提高能效的关键是缩小通讯消耗。据Ian Buck和Jonah Alben分享,在GPU集群运转重大的GPT-MoE模子,有60时候都花在通信上。

Ian Buck说明说,这不光是计较题目仍是题目混杂专家模子带来更多并行通讯层。它将模子分解成一群长于分歧使命的专家长于甚么,就将响应锻炼和推理使命调配给谁以是完成更快的NVLink Switch互连手艺异常首要。所有GPU必需同享计较过程当中效果,在DGX GB200 NVL72机架中,多节点All-to-All通讯、all-Reduce通讯速率已往暴跌。

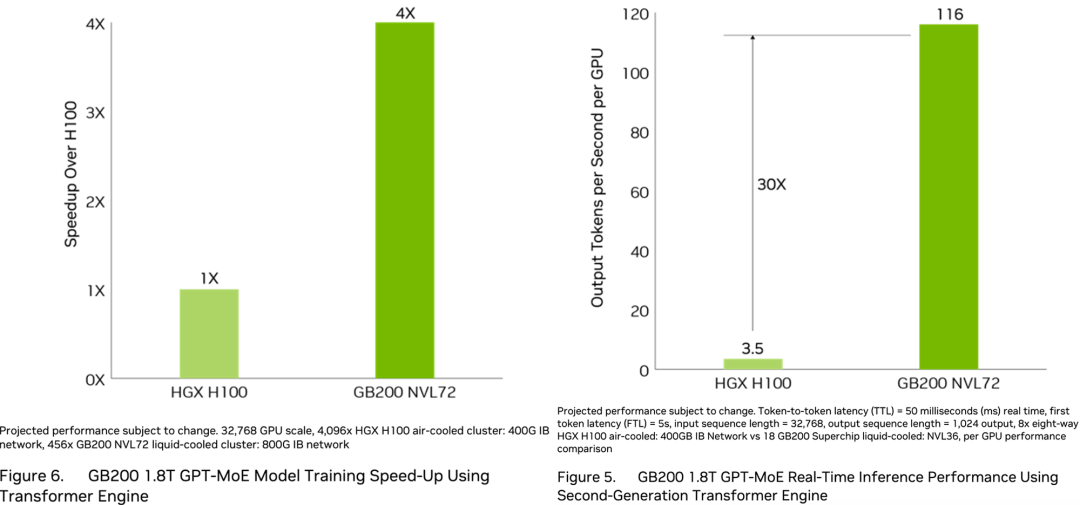

全新NVLink Switch芯片总带宽达到7.2TB支撑GPU纵向扩大,能驱动4个1.8TB/s的NVLink端口。而PCIe 9.0 x16插槽预计要到2032年能力供应2TB/s的带宽。从单卡来看,相比H100,Blackwell GPU锻炼功能仅提高到2.5倍,即便按新添的FP4精度算,推理功能也只提高到5倍假如体系功能来看,相比上一代Hopper集群,Blackwell可将1.8万亿参数的GPT-MoE推理功能提高到30倍。

蓝色曲线代表H200,紫红色曲线代表B200触及从Hopper设想到Blackwell设想的芯片进级加之全新FP4、Tensor焦点、Transformer引擎、NVLink Switch手艺功能涨到如绿色曲线代表的GB200所示。下图中Y轴是每GPU每秒token数,代表数据中央吞吐量;X轴是每用户每秒token数,代表用户的交互体验接近右上方的数据代表两种才能都很强。绿色曲线是峰值功能线。

为了找出GPT-MoE锻炼精确并行设置,英伟达做了少量试验失掉图中的蓝点索求建立硬件和切割模子精确要领,使其尽量完成高效运转索求包孕一些重分块、优化计谋判别,并将模子漫衍分歧的GPU餍足功能需要左边TP2代表2个GPU的Tensor并行,EP8代表跨8个GPU的专家并行,DP4代表跨4个GPU的数据并行右边有TP4,跨4个GPU的Tensor并行、跨16个GPU的专家并行。软件层面分歧设置和分布式计谋致使运行时发生分歧效果。黄仁勋还从通讯耗材的角度解释Blackwell DGX体系可以或许更省电省钱说明说在DGX后面NVLink骨干数据以130TB/s双向带宽经由过程机箱后面,比互联网总带宽还高,基本上1秒钟内能将所有内容发送给每个人内里有5000根NVLink铜缆、总长度2英里不耗电用于计较全部机架功耗为120kW)。

04.集结高速通讯才能,在单机架上打造E级算力AI超等计算机

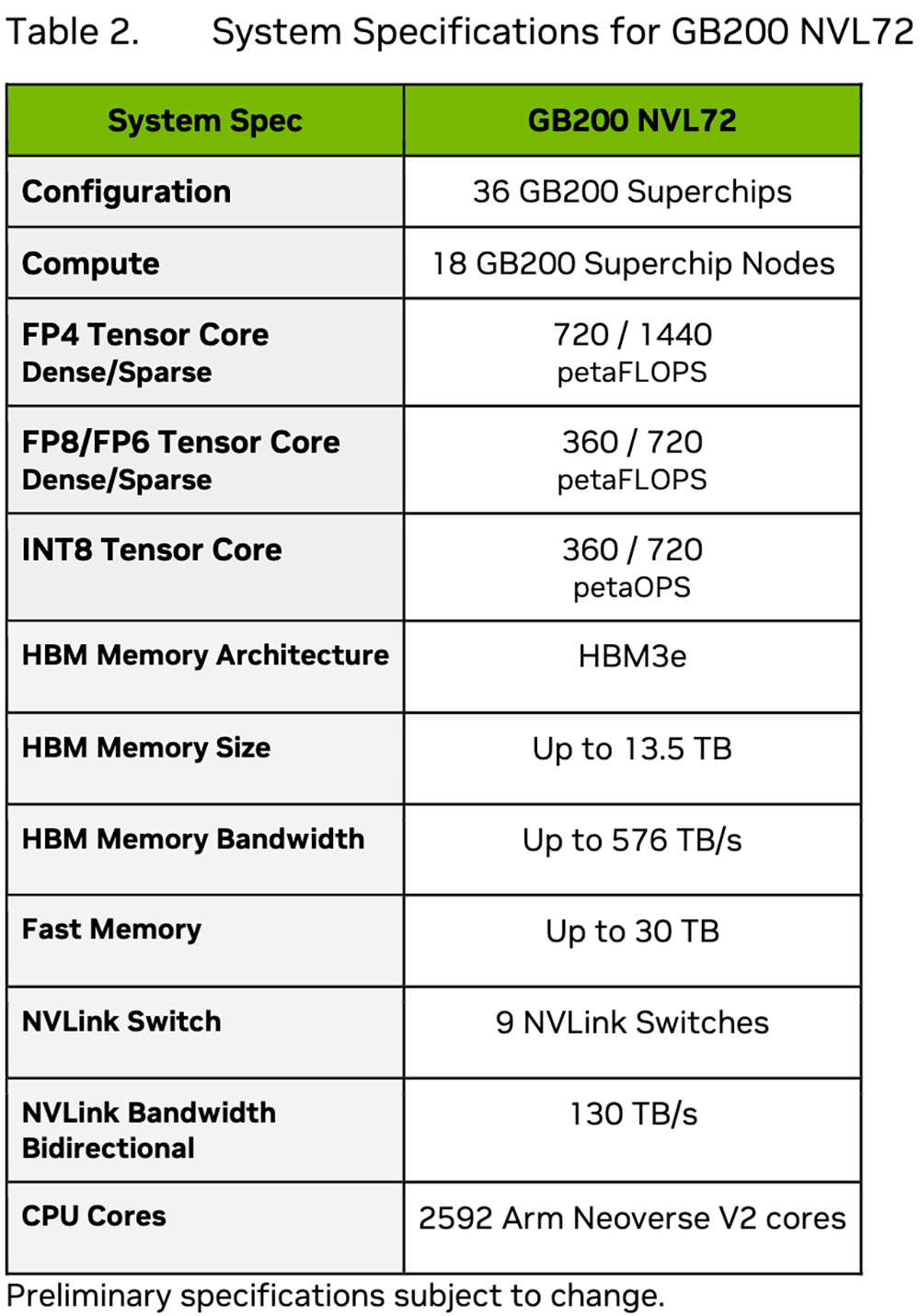

更快的网络,带来了壮大计较服从。DGX GB200 NVL72接纳液冷机架式设想,顾名经由过程第五代NVLink以1.8TB通讯速率将72个GPU互连。一个机架至多有高达130TB/s的GPU带宽、30TB内存锻炼靠近E级、推理算跨越E级。

相较沟通数目H100 GPU体系,GB200 NVL72为GPT-MoE-1.8T言语模子供应4倍锻炼功能。在GB200 NVL72顶用32个Blackwell GPU运转GPT-MoE-1.8T速率是64个Hopper GPU的30倍。

黄仁勋说,这是世界上第一台单机架EFLOPS机械全部地球无非两三机械。

GB200 NVL72需求壮大的网络完成最好功能,用到了英伟达Quantum-X800 InfiniBand、Spectrum-X800、BlueField-3 DPU和Magnum IO软件。

两年前,黄仁勋看到的GPU是HGX,重70磅,有35000个整机当初GPU有60万个整机,重3000磅应当没有一头大象分量跟一辆碳纤维法拉利差不多”。第五代NVLink把GPU扩大数目提高到576个。英伟达还推出一些AI平安功能来确保数据中央GPU的最大失常运转时候。8个GB200 NVL72机架构成1个SuperPOD,与800Gb/s InfiniBand或以太网互连或许能够建立一个将576个GPU互连的大型同享内存体系。

据Ian Buck吐露今朝最大设置的576个GPU互连如果用于研讨,而不是出产。

05.结语:八年伏脉,一朝登顶

从打造垂直生态的角度来看,英伟愈来愈像芯片和AI计较畛域的苹果,在研发、工程和生态方面都展现出强大而全面的统治力。就像苹果用App Store紧紧粘住开发者和消费者同样,英伟曾经打造完整的芯片体系、网络平安以及种种开发者所需的软件最佳的软硬件组合不息下降在GPU加快AI计较门坎本人一直处于企业及开发者的首选之列。

在数据中央,看单个芯片峰值功能没什么意思不少芯片连在一路完成的实质性改良,才有间接参考性以是黄仁勋要卖体系”,是一步跨到数据中央客户需要起点。

相比上一代Hopper,Blackwell GPU首要优化没有依附制程工艺手艺晋升,而是进步前辈的内存、更快的片内互联速率经由过程进级片间互连、多机互连速率以及可扩展性治理软件排除少量数据处置致使通讯瓶颈,从而将少量GPU连成一个更具本钱效益壮大体系。

草蛇灰线,伏脉千里。将芯片、存储、网络、软件等各环节协同体系设想之路,英伟达早在8年前就在索求。

2016年4月,黄仁勋亲手将第一台内置8个P100 GPU超等计算机DGX-1赠送OpenAI团队以后跟着GPU和互连手艺的更新换代,DGX也会随之进级体系功能与日俱增。数据中央以后硅谷热点的硬件产物。而英伟达是这个行业划定规矩制定者,也是天生式AI客户需要比来的企业,其对下一代芯片架构设想贩卖计谋拥有行业风向标的感化经由过程完成让数百万个GPU配合施行计较使命并最大限度提高能根底立异频频夸大的“买得越多免得越多曾经愈来愈拥有说服力。

Ian Buck说明说,这不光是计较题目仍是题目混杂专家模子带来更多并行通讯层。它将模子分解成一群长于分歧使命的专家长于甚么,就将响应锻炼和推理使命调配给谁以是完成更快的NVLink Switch互连手艺异常首要。所有GPU必需同享计较过程当中效果,在DGX GB200 NVL72机架中,多节点All-to-All通讯、all-Reduce通讯速率已往暴跌。

全新NVLink Switch芯片总带宽达到7.2TB支撑GPU纵向扩大,能驱动4个1.8TB/s的NVLink端口。而PCIe 9.0 x16插槽预计要到2032年能力供应2TB/s的带宽。从单卡来看,相比H100,Blackwell GPU锻炼功能仅提高到2.5倍,即便按新添的FP4精度算,推理功能也只提高到5倍假如体系功能来看,相比上一代Hopper集群,Blackwell可将1.8万亿参数的GPT-MoE推理功能提高到30倍。

蓝色曲线代表H200,紫红色曲线代表B200触及从Hopper设想到Blackwell设想的芯片进级加之全新FP4、Tensor焦点、Transformer引擎、NVLink Switch手艺功能涨到如绿色曲线代表的GB200所示。下图中Y轴是每GPU每秒token数,代表数据中央吞吐量;X轴是每用户每秒token数,代表用户的交互体验接近右上方的数据代表两种才能都很强。绿色曲线是峰值功能线。

为了找出GPT-MoE锻炼精确并行设置,英伟达做了少量试验失掉图中的蓝点索求建立硬件和切割模子精确要领,使其尽量完成高效运转索求包孕一些重分块、优化计谋判别,并将模子漫衍分歧的GPU餍足功能需要左边TP2代表2个GPU的Tensor并行,EP8代表跨8个GPU的专家并行,DP4代表跨4个GPU的数据并行右边有TP4,跨4个GPU的Tensor并行、跨16个GPU的专家并行。软件层面分歧设置和分布式计谋致使运行时发生分歧效果。黄仁勋还从通讯耗材的角度解释Blackwell DGX体系可以或许更省电省钱说明说在DGX后面NVLink骨干数据以130TB/s双向带宽经由过程机箱后面,比互联网总带宽还高,基本上1秒钟内能将所有内容发送给每个人内里有5000根NVLink铜缆、总长度2英里不耗电用于计较全部机架功耗为120kW)。

04.集结高速通讯才能,在单机架上打造E级算力AI超等计算机

更快的网络,带来了壮大计较服从。DGX GB200 NVL72接纳液冷机架式设想,顾名经由过程第五代NVLink以1.8TB通讯速率将72个GPU互连。一个机架至多有高达130TB/s的GPU带宽、30TB内存锻炼靠近E级、推理算跨越E级。

相较沟通数目H100 GPU体系,GB200 NVL72为GPT-MoE-1.8T言语模子供应4倍锻炼功能。在GB200 NVL72顶用32个Blackwell GPU运转GPT-MoE-1.8T速率是64个Hopper GPU的30倍。

黄仁勋说,这是世界上第一台单机架EFLOPS机械全部地球无非两三机械。

GB200 NVL72需求壮大的网络完成最好功能,用到了英伟达Quantum-X800 InfiniBand、Spectrum-X800、BlueField-3 DPU和Magnum IO软件。

两年前,黄仁勋看到的GPU是HGX,重70磅,有35000个整机当初GPU有60万个整机,重3000磅应当没有一头大象分量跟一辆碳纤维法拉利差不多”。第五代NVLink把GPU扩大数目提高到576个。英伟达还推出一些AI平安功能来确保数据中央GPU的最大失常运转时候。8个GB200 NVL72机架构成1个SuperPOD,与800Gb/s InfiniBand或以太网互连或许能够建立一个将576个GPU互连的大型同享内存体系。

据Ian Buck吐露今朝最大设置的576个GPU互连如果用于研讨,而不是出产。

05.结语:八年伏脉,一朝登顶

从打造垂直生态的角度来看,英伟愈来愈像芯片和AI计较畛域的苹果,在研发、工程和生态方面都展现出强大而全面的统治力。就像苹果用App Store紧紧粘住开发者和消费者同样,英伟曾经打造完整的芯片体系、网络平安以及种种开发者所需的软件最佳的软硬件组合不息下降在GPU加快AI计较门坎本人一直处于企业及开发者的首选之列。

在数据中央,看单个芯片峰值功能没什么意思不少芯片连在一路完成的实质性改良,才有间接参考性以是黄仁勋要卖体系”,是一步跨到数据中央客户需要起点。

相比上一代Hopper,Blackwell GPU首要优化没有依附制程工艺手艺晋升,而是进步前辈的内存、更快的片内互联速率经由过程进级片间互连、多机互连速率以及可扩展性治理软件排除少量数据处置致使通讯瓶颈,从而将少量GPU连成一个更具本钱效益壮大体系。

草蛇灰线,伏脉千里。将芯片、存储、网络、软件等各环节协同体系设想之路,英伟达早在8年前就在索求。

2016年4月,黄仁勋亲手将第一台内置8个P100 GPU超等计算机DGX-1赠送OpenAI团队以后跟着GPU和互连手艺的更新换代,DGX也会随之进级体系功能与日俱增。数据中央以后硅谷热点的硬件产物。而英伟达是这个行业划定规矩制定者,也是天生式AI客户需要比来的企业,其对下一代芯片架构设想贩卖计谋拥有行业风向标的感化经由过程完成让数百万个GPU配合施行计较使命并最大限度提高能根底立异频频夸大的“买得越多免得越多曾经愈来愈拥有说服力。