面向实际应用的室内单目深度估计 Toward Practical Monocular Indoor Depth Estimation

时间:2023-09-21 23:37:02

Toward Practical Monocular Indoor Depth Estimation

室内单目实际应用的深度估计

??(个人观点)本文描述的工作是DPT和一个汉明距离的损失函数,DPT它是基于深度传感器训练的,汉明距离的两个损失没有太大的创新。就我个人而言,我认为提高指标的概率取决于深度真实价值训练DPT结果。摘要中描述的结构化蒸馏主要针对DPT是的,文章中没有相关描述。总的来说还是堆砌的,但是顶会!

0 Abstract

??现有的大多数单目深度估计方法都部署在室外驾驶场景中。由于室内物体排列紧密,靠近摄像头不规则,该方法在室内的泛化性很差(不同场景导致模型的泛化性很差是基于数据驱动方法的常见问题,这是可以理解的,但室内环境一般比室外环境更复杂,这确实存在)。为了提高模型的鲁棒性,我们从现成的相对深度估计器中学习了一种结构蒸馏方法,产生了结构化和测量深度,并进行了实时推理。本文模拟数据集SimSIM和真实数据集UniSIM评估和测试。

1 Introduction

??本文提出了具有以下特点的实用室内单目深度估计框架:从现有估计器和无深度注释的左右图像中学习,有效收集培训数据,提高跨数据集的泛化性、准确性和深度感应。我们的工作适用于消费者AR/VR,例如3D室内场景重建和虚拟对象插入以及环境的交互,最近自监督深度估计受到了广泛的关注,一些方法在室外的数据集例如KITTI和CiityScapes由于以下原因,室内自监深度估计会更具挑战性。

- 结构先验:室外场景在训练前往往增加了强大的场景结构,通常由天空和建筑上部深度较远,下部道路分布较近,相比之下,室内物体分布在进入环境中,使室内结构先验比室外弱得多。

- 驾驶场景的深度通常从近到远排列,但室内深度可以聚集在远或近的分布中,如桌子和天花板,分布不均匀使室内深度预测更加复杂。

- 相机位置:室内相机可以在六个自由度上移动,但室外相机通常固定在汽车上收集,平移没有高度,旋转以偏航角为主。因此,室内自监督网络在预测相机位置时更加复杂。

- 无纹理区域:由于室内有大范围的无纹理区域,如墙壁、桌面、天花板等,室内光度损失的效果会,本文提出DistDepth,这种结构化蒸馏方法可以通过自我监督学习提高精度。

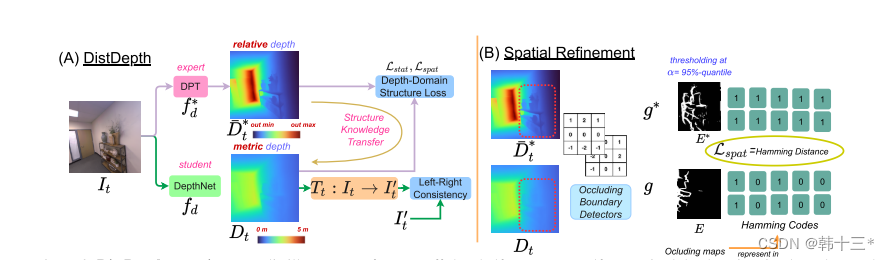

??本文采用结构蒸馏法,可通过自监督学习提高深度精度。DistDepth使用现有的相对深度估计器DPT(dense prediction transformers 密集预测变换器是一一个主要的网络,它使用视觉转换器代替卷积网络作为密集的预测任务),估计器结构化,但只产生相对深度(输出深度值只反映排序,与测量5无关)。在统计和空间上,我们的结构蒸馏策略鼓励深度结构相似性DPT深度排序可以有效地融入从左到右一致性训练的测量估计分支。蒸馏也可以获奖DPT大型视觉转换器缩小到较小的框架,可以实时推断便携式设备。

??在单目深度估计方向上,目前的数据集要么针对驾驶场景、小规模、缺乏场景,要么采用计算机引擎渲染,缺乏三维。本文常用Habitat传感器收集了范围3D场景的三维对,包括1K个场景和500K三维室内图像的模拟。以前的方法是SimSIN在训练过程中,泛化性很差,但在采用本文的结构蒸馏方法后,我们的模型可以在模拟数据集中产生高度的结构化和精确的测量深度。本文缩小了模拟与现实与现实之间的差距。

2 Related Work

??监督深度估计需要像素级的深度标记。早期的方法是利用卷积神经网络回归像素值的深度值,以最小化预测与真值之间的损失。采用最近的方法ViT(vision transformers)采用混合数据集训练,采用尺度和唯一不变性进行大规模深度训练,进行密集预测。野生图像的细粒度结构可以用最先进的方法来估计,但由于混合数据训练策略,它们只提供相对深度。

??左右一致性和时间一致性有助于实现自我监督单目的深度估计。有些方法可以实现自我监督的深度估计,但都集中在室外驾驶场景上。本文的结构蒸馏不同于传统蒸馏,DPT只有输出深度排序,结合DepthNet产生最终输出。

3 Method

??在三维训练中(即双眼视觉,同时输入左右视图),光度损失被定义为左右视图的扭曲重构损失,时间一致性被定义为前后帧的光度损失。主要的训练过程分为蒸馏相对深度的两部分DPT,以视觉转换器代替卷积网络作为密集预测任务的主要网络,D-*t是D*t的粗略优化,优化参数缩放as和位移at通过最小二乘法最小化以下公式来计算得到。下面是立体训练的左右视差一致性,扭曲和PoseNet没有画。获得的相对深度图D-*t预测深度图Dt损失统计Lstat空间细化损失Lspat约束网络。

??统计损失如下,采用1减去结构相似度作者介绍,视差到深度放大了预测的不准确性,与结合相比L1的损失函数,可以更好地拟合图中的结构信息。

??通过空间细化损失sobel算子计算相对深度图D-*t预测深度图Dt对应的深度图g* 和通过阈值α=二值化操作95%,梯度值大于此值的为1,其余为0,获得两个二值化图E*和E,计算距离计算两个二值化图(来自信息论计算两个编码的差异)。E*与E不同或计算,然后除以领域的大小。

??汉明距离的最终损失如下:Ldist =Lstat 10?1Lspat

4 Datasets

??对三个数据集进行了评估SimSIN、UniSIN、VA和NYUv2.前两个是作者自己做的,也是本文的一部分。第一个是真实的3D第二个是虚拟数据集。

5 Experiments and Analysis

??VA虚拟数据集测试结果。

??不同DPT测试结果。

??NYUv2测试结果。