初探神经网络(一)开始于M-P模型

时间:2023-09-10 09:07:02

全文内容约4500字,结合理解能力,单次阅读时间约9分钟。

神经网本质上不是什么新鲜事。神经网络被归类为深度学习的内容之一,其使用和探索从来都不是什么新鲜事,包括多年的开发和尝试应用,不断改进和取代当前算法的局限性。我的本科专业是应用统计学。我从大二开始接触专业课程。我第一次听到神经网络,就好像中国人突然从一个国内的香蕉人那里听到了一糟糕的英语。你非常鄙视这种听虚张声势的话,你必须尽力理解这些蹩脚的话,以别人用外语问候你的家人。你会尝试学习它,在学习的过程中,你会明白这个领域仍然远离现在,深入学习,deep learning(嗯,又一个洋文短语。所以这里真的要吐槽一下,总有人为这种英文命名正名,说是用英文更能表达概念的原本含义。汉语、日语等都是字表意,英语等印欧语系-日耳曼语系的语言都是字表意。你可以比较新华词典和牛津高级词典的厚度和大小。顺便说一句,牛津高级只记录了18个W,还不包括文献出现的不常用单词和未记录在册的俚语,区区词组用中文还解释不了了?不要为了拖词而拖词。听了英语,要自己翻译,然后还要用中文理解肚子里的意思。否则,你会认为鲁棒这个蹩脚的词是怎么来的。吐槽完毕)。

虽然在学术界的大牛看来,深度学习是对旧概念的炒作。然而,由于神经网络本身的非线性和连接的复杂性,这个概念确实比一般的浅算法复杂得多。从这个角度来看,称之为深是有道理的。

神经网络的发展应该从生物科学对神经元的理解开始。总之,神经元受到刺激后会释放物质,发出刺激信号,不受刺激就不会发出信号。就像电器开关一样。简化这个过程后,就变成了a->b。可这么简化,跨度实在是太大,于是为了将这个过程描述的更好理解一点,M-P1943年神经元模型Warren McCulloch和Walter Pitts提出(名字是父母给的,这个不是汉化的)。两人致力于研究大脑如何处理信息。McCulloch另一位神经心理学家在玩青蛙Donald Hebb研究黑猩猩的情感和学习能力,Hebb黑猩猩并没有被成功地教导成材,获得了学位什么的,但他却从中学到了一套生物学习的规则。1949年,Hebb《行为组织学》出版Organization of Behavior”)一书。在该书中,Hebb总结提出后人称之为赫布法则(Hebb’s Law)学习机制。他认为如果两个神经元细胞总是同时被激活,它们之间就会有一些相关性,激活的概率越高,相关性就越高。

1.M-P神经元模型

M-P来自两位创始人的姓氏首字母,没有主次顺序。先介绍这两个。

Warren Sturgis McCulloch,1898~1969年,美国神经生理学和控制论科学家。哥伦比亚大学博士,先后在麻省理工学院、耶鲁大学和芝加哥大学任教。

Walter Harry Pitts, Jr.,1923~1969年,美国计算神经学家。这个人的经历真的很不典型。家个家庭很穷,大约不能上大学。15岁时,他去芝加哥大学Bertrand Russell的讲座。Russell他非常重视这个年轻人,但因为他只是一个访问学者,所以他会在回家之前Pitts介绍给Rudolf Carnap,后者为Pitts在学校安排一份工作。这份工作持续了五六年,最后凭借论文获得了芝加哥大学的准学士学位(因为他从来都不是正式学生),这是他一生中唯一的学位。但是如果你看的话Pitts合作伙伴伙伴的阵容Pitts高水平。他们是:Warren McCulloch、Jerome Lettvin(麻省理工学院著名认知心理学家、教授,最著名的工作是1959年发表的论文《What the frog’s eye tells the frog’s brain》,这篇论文是SCI引用次数最多的论文之一)Norbert Wiener(数学家,控制论是这个人写的。 )

首先复习高中生物学知识。

1.神经元的主要结构分为三部分: N个树突 细胞体 突触。

2.神经元之间的连接是树突连接(另一个神经元)的突触。这种首尾连接的结构,N树突可以连接N个神经元。

3.神经递质是突触传递中作为信使的特定化学物质,简称递质。

4.信号的传输方式是N个神经元通过树突传递神经递质,在递质上附加生物电。当生物电累积到一定的阙值时,会刺激突触发信号。

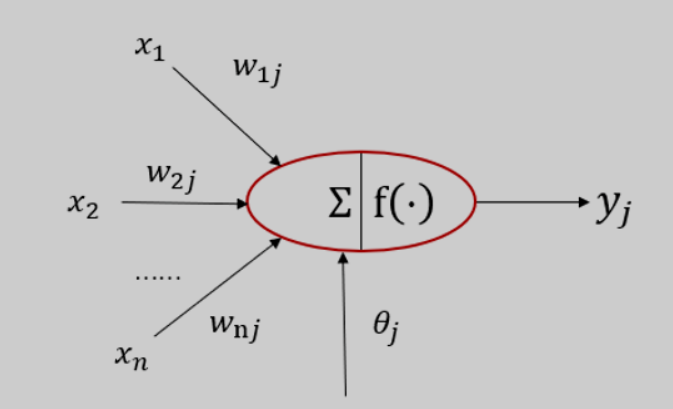

阅读以下描述时,请根据高中生物知识保持以下模型。对于某个神经元 j j j ,许多输入信号可能同时被接受 x i ( i = 1 , 2 , 3 , . . . , n ? 1 , n ) x_i(i = 1,2,3,...,n-1,n) xi(i=1,2,3,...,n?1,n)表示,对于神经元的影响存在兴奋和抑制, x i x_i xi 其正负模拟了生物神经元中突出的兴奋和抑制。由于生物神经元具有不同的突触性质和突触强度,其中各信号对 j j j 的影响是不同的,因此需要引入权重(weight)的概念,“权”在加权平均中,表达的含义是不等精度观测值在计算未知量的最可靠值时所占的“比重”或“份额”,这里的权用于衡量影响程度,用 w i j w_{ij} wij 表示,输入信号及其对应权重会对 j j j 有一个共同影响,表达为 w 1 j x 1 + w 2 j x 2 + w 3 j x 3 + . . . + w n j x n w_{1j}x_1 + w_{2j}x_2 + w_{3j}x_3 + ... + w_{nj}x_n w1jx1+w2jx2+w3jx3+...+wnjxn,即 ∑ i = 1 n w i j x i \sum_{i=1}^{n} w_{ij}x_i ∑i=1nwijxi。这股“合力”能否使得神经元 j j j 受到足够的能量从而被刺激呢?需要一个阈值 θ j \theta_j θj(Threshold)进行衡量,当 ∑ ⩽ θ j \sum \leqslant \theta_j ∑⩽θj,说明不足以突破阈值,就好比一个弱女子一记粉拳打在了泰森的肚子上,不痛不痒,该配合你演出的泰森演视而不见,自然也不会痛到叫出声。但要是超过了能忍受的范围,即超过了阈值,那么 ∑ > θ j \sum >\theta_j ∑>θj,此时受到刺激,对外发出信号,该神经元 j j j 在外界视角看来就是激活的状态。

现在的衡量标准依靠 ∑ \sum ∑以及 θ j \theta_j θj之间的大小关系来衡量,我们转化为:

∑ i = 1 n w i j x i − θ j \sum_{i=1}^{n} w_{ij}x_i - \theta_j i=1∑nwijxi−θj

其中神经元的激活受两两对应的权重和输入信号共同影响,类比在高等代数中线性方程组的写法, X X X 表示输入向量,用 W W W 表示权重向量,即有如下表示:

X = [ x 1 , x 2 , . . . , x n ] X = [x_1,x_2,...,x_n] X=[x1,x2,...,xn]

W = [ w 1 j , w 2 j , . . . , w n j ] T W = [w_{1j},w_{2j},...,w_{nj}]^T W=[w1j,w2j,...,wnj]T

而此时还包括一个阈值 θ j \theta_j θj ,转化思想我们可以将阈值看成是神经元 j j j 的一个输入 x 0 x_0 x0 的权重 w 0 j w_{0j} w0j,那么就有以下表示。此时阈值作为一个确定常数 x 0 x_0 x0 和确定输入信号权重的 w 0 j w_{0j} w0j,也被纳入到了输入向量和权重向量中:

X = [ x 0 , x 1 , x 2 , . . . , x n ] X = [x_0,x_1,x_2,...,x_n] X=[x0,x1,x2,...,xn]

W = [ w 0 j , w 1 j , w 2 j , . . . , w n j ] T W = [w_{0j},w_{1j},w_{2j},...,w_{nj}]^T W=[w0j,w1j,w2j,...,wnj]T

对应的,神经元 j j j 收到的刺激之和(包含了所有的兴奋和抑制),可以表现为向量相乘的形式:

n e t j = W X net_j = WX netj=WX

其中的 n e t j net_j netj 就是我们在做类比时提到的所谓“合力”。根据上述的大小关系: ∑ > θ j \sum >\theta_j ∑>θj 时受到刺激,对外发出信号,结合现在的推导结果,此时可表示为:

y j = { 受 到 刺 激 ( n e t j ⩽ 0 ) 无 反 应 ( n e t j > 0 ) y_j=\left\{ \begin{aligned} 受到刺激 &&(net_j \leqslant 0) \\ 无反应 && (net_j > 0) \end{aligned} \right. yj={ 受到刺激无反应(netj⩽0)(netj>0)

其中 y j y_j yj 表示神经元 j j j 的对外输出。这个式子可以描述为神经元被激活的规则。后面的章节我会将这个规则推广到一般,这种规则既是M-P模型的所谓“激活函数”,而这种模式将会成为后续神经网络复杂模型的最小处理单元(PE,Processing Element),因为它描述的是一个神经元的变化情况。

基于上文,我们回到一开始提到的背景中的赫布法则,可以理解为:如果两个神经元同时激发,则它们之间的连接权重就会增加;如果只有某个神经元单独激发,则它们之间的连接权重就应减少。赫布法则是最古老的也是最简单的神经网络学习规则。

以上是M-P模型结合前辈探索和知识传承,结合个人理解后想要表达的具体内容。

最后还想补充一些留有印象的思考题,来自我,学弟学妹们,同事们,问题仅关注M-P模型本身:

Q1: ∑ i = 1 n w i j x i − θ j \sum_{i=1}^{n} w_{ij}x_i - \theta_j ∑i=1nwijxi−