对抗攻击与防御 (1):图像领域的对抗样本生成

时间:2023-07-25 16:37:00

文章目录

- 1 引入

- 2 白盒攻击

-

- 2.1 Biggio

- 2.2 Szegedy's limited-memory BFGS (L-BFGS)

- 2.3 Fast gradient sign method (FGSM)

- 2.4 DeepFool

- 2.5 Jacobian-based saliency map attack (JSMA)

- 2.6 Basic iterative method (BIM) / Projected gradient descent (PGD) attack

- 2.7 Carlini & Wagner′s attack (C&W′s attack)

- 2.8 Ground truth attack

- 2.9 其他 l p l_p lp攻击

- 2.10 全局攻击 (universal attack)

- 2.11 空间转换攻击 (spatially transformed attack)

- 2.12 对抗样本没有约束

- 3 物理世界攻击

-

- 3.1 探索物理世界对抗样本

- 3.2 道路标志的Eykholt攻击

- 3.3 Athaly的3D对抗对象

- 4 黑盒攻击

-

- 4.1 替换模型

- 4.2 ZOO:基于零阶优化的黑盒攻击

- 4.3 黑盒攻击的高效查询

- 5 灰盒攻击

- 6 中毒攻击

-

- 6.1 Biggio在SVM中毒攻击

- 6.2 Koh的模型解释

- 6.3 毒青蛙 (poison frogs)

- 参考文献

1 引入

??与其他领域相比,图像领域的对抗样本生成如下优势:

??1)观察者直观地看到真实图像和虚假图像;

??2)图像数据和图像分类器的结构相对简单。

??主要内容:以全连接网络和卷积神经网络为例MNIST、CIFAR10,以及ImageNet基于基本样本的研究逃避对抗,图像对抗样本生成包括白盒、黑盒、灰盒和物理攻击。

2 白盒攻击

??攻击者接收分类器 C C C与受害样本 (victim sample) ( x , y ) (x,y) (x,y) 之后,其目标是合成一个在感知上与原始图像相似但可能误导分类器给出错误预测结果的虚假图像:

找到 x ′ 满足 ∥ x ′ ? x ∥ ≤ ? , 例 如 C ( x ′ ) = t ≠ y , (1) \tag{1} \text{找到}x'\text{满足}\|x'-x\|\leq\epsilon,\ 例如C(x')=t\neq y, 找到x′满足∥x′−x∥≤ϵ, 例如C(x′)=t=y,(1)其中 ∥ ⋅ ∥ \|\cdot\| ∥⋅∥用于度量 x ′ x' x′与 x x x的不相似性,通常为 l p l_p lp范数。接下来介绍该攻击手段下的主要方法。

2.1 Biggio

在MNIST数据集上生成对抗样本,攻击目标是传统的机器学习分类器,如SVM和3层全连接神经网络,且通过优化判别函数来误导分类器。

例如图1中,对于线性SVM,其判别函数 g ( x ) = < w , x > + b g(x)=

2.2 Szegedy’s limited-memory BFGS (L-BFGS)

首次应用在用于图像分类的神经网络上,其通过优化以下目标来寻找对抗样本:

min ∥ x − x ′ ∥ 2 2 s.t. C ( x ′ ) = t and x ′ ∈ [ 0 , 1 ] m . (2) \tag{2} \begin{array}{l} & \min &\|x-x'\|_2^2\qquad \text{s.t.} C(x') = t\ \text{and }x'\in[0,1]^m. \end{array} min∥x−x′∥22s.t.C(x′)=t and x′∈[0,1]m.(2) 通过引入损失函数来近似求解该问题:

min λ ∥ x − x ′ ∥ 2 2 + L ( θ . x ′ , t ) , s.t. x ′ ∈ [ 0 , 1 ] m , (3) \tag{3} \min\ \lambda\|x-x'\|_2^2+\mathcal{L}(\theta.x',t), \qquad\text{s.t. }x'\in[0,1]^m, min λ∥x−x′∥22+L(θ.x′,t),s.t. x′∈[0,1]m,(3)其中 λ \lambda λ是一个规模参数。通过调整 λ \lambda λ,可以找到一个与 x x x足够相似的 x ′ x' x′,且同时误导分类器 C C C。

2.3 Fast gradient sign method (FGSM)

Goodfellow等人设计了一个一步到位的快速对抗样本生成方法:

x ′ = x + ϵ sign ( ∇ x L ( θ , x , y ) ) , 非目标 x ′ = x − ϵ sign ( ∇ x L ( θ , x , t ) ) , 目标 t (4) \tag{4} \begin{aligned} &x'=x+\epsilon\text{ sign}(\nabla_x\mathcal{L}(\theta,x,y)),\qquad\text{非目标}\\ &x'=x-\epsilon\text{ sign}(\nabla_x\mathcal{L}(\theta,x,t)),\qquad\text{目标}t \end{aligned} x′=x+ϵ sign(∇xL(θ,x,y)),非目标x′=x−ϵ sign(∇xL(θ,x,t)),目标t(4) 在目标攻击设计下,该问题可以通过一步梯度下降求解:

min L ( θ , x ′ , t ) s.t. ∥ x ′ − x ∥ ∞ and x ′ ∈ [ 0 , 1 ] m . (5) \tag{5} \min\mathcal{L}(\theta,x',t)\qquad\text{s.t. }\|x'-x\|_\infty\text{ and }x'\in[0,1]^m. minL(θ,x′,t)s.t. ∥x′−x∥∞ and x′∈[0,1]m.(5) FGSM快速的一个原因是其仅需一次反向传播,因此适应于生成大量对抗样本的情况,其在ImageNet上的应用如图2。

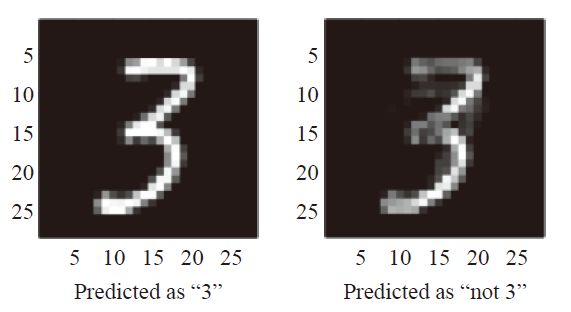

2.4 DeepFool

研究分类器 F F F围绕数据点的决策边界,试图找到一条可以超越决策边界的路径,如图3,从而误分类样本点 x x x。例如,为误判类别为4的样本 x 0 x_0 x0到类别3,决策边界可以被描述为 F 3 = { z : F ( x ) 4 − F ( x ) 3 = 0 } \mathcal{F}_3=\{ z:F(x)_4 - F(x)_3 = 0 \} F3={

z:F(x)4−F(x)3=0}。令 f ( x ) = F ( x ) 4 − F ( x ) 3 f(x)=F(x)_4 - F(x)_3 f(x)=F(x)4−F(x)3,在每次攻击中,它将使用泰勒展开 F 3 ′ = { x : f ( x ) ≈ f ( x 0 ) + < ∇ x f ( x 0 ) − ( x − x 0 ) > = 0 } \mathcal{F}_3'=\{ x:f(x)\approx f(x_0) + < \nabla_xf(x_0)-(x-x_0)>=0 \} F3′={

x:f(x)≈f(x0)+<∇xf(x0)−(x−x0)>=0}来线性化决策超平面,并计算 ω 0 \omega_0 ω0到超平面 F 3 ′ \mathcal{F}_3' F3′的正交向量 ω \omega ω。向量 ω \omega ω可以作为扰动使得 x 0 x_0 x0游离于超平面。通过移动 ω \omega ω,算法将找到可以被分类为3的对抗样本 x 0 ′ x_0' x0′。

DeepFool的实验结果展示,对于一般性的DNN图像分类器,所有的测试样本都非常接近决策边界。例如LeNet在MNIST数据集上训练好后,只需些许扰动,超过90%的样本都将被误分类,这表面DNN分类器对扰动是不健壮的。

2.5 Jacobian-based saliency map attack (JSMA)

JSMA介绍了一种基于计算评分函数 F F F雅可比矩阵的方法,其迭代地操作对模型输出影响最大的像素,可被视为一种贪心攻击算法。

具体地,作者使用雅可比矩阵 J F ( x ) = ∂ F ( x ) ∂ x = { ∂ F j ( x ) ∂ x i } i × j \mathcal{J}_F(x)=\frac{\partial F(x)}{\partial x}=\left\{ \frac{\partial F_j(x)}{\partial x_i} \right\}_{i\times j} JF(x)=∂x元器件数据手册、IC替代型号,打造电子元器件IC百科大全!